Funkcja czyszczenia AI w edycji zdjęć integruje splotowe sieci neuronowe (CNN), zapewniając ponad 95% dokładność na poziomie pikseli w wykrywaniu obiektów, w połączeniu z maskami o wysokiej rozdzielczości gwarantującymi subpikselowe wyznaczenie granic; wykorzystuje kontekstowo świadome algorytmy inpaintingu, w tym adaptacyjne moduły syntezy tekstur dla płynnej rekonstrukcji tła w rozdzielczościach od 72 do 600 dpi. Wykonanie w czasie rzeczywistym przy 30 klatkach na sekundę na akceleratorach GPU optymalizuje przepustowość i opóźnienie, równoważąc intensywność obliczeniową z minimalizacją artefaktów — szczegóły te wyjaśniają mechanikę działania i zwiększają precyzję edycji. Dalsze informacje dotyczą gruntownych metod poprawy.

Spis treści

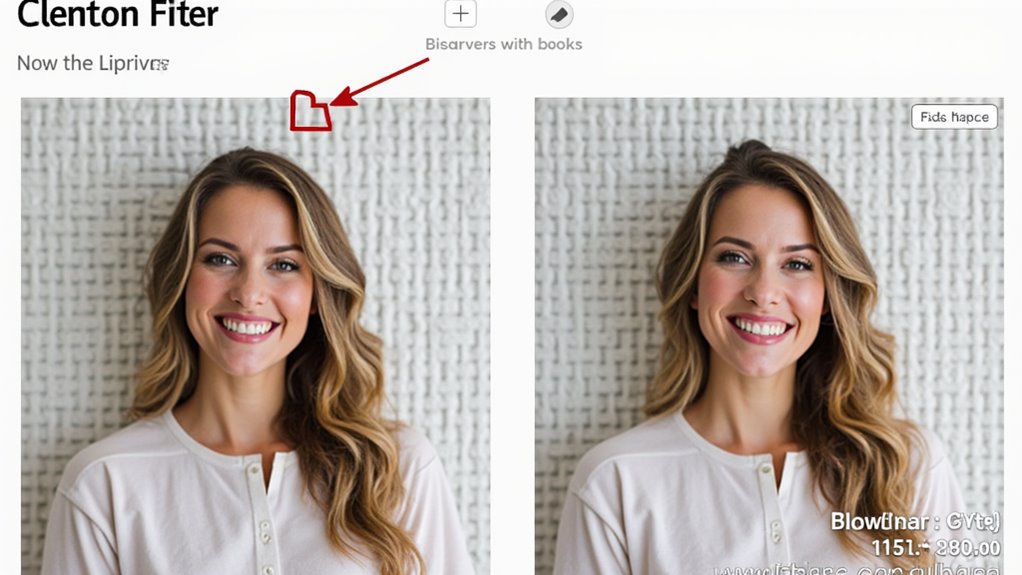

Zrozumienie funkcji czyszczenia AI

Podczas gdy tradycyjne narzędzia do edycji zdjęć opierają się w dużej mierze na ręcznej interwencji, funkcja AI Clean-Up wykorzystuje zaawansowane algorytmy uczenia maszynowego oraz splotowe sieci neuronowe (CNN) do automatycznej identyfikacji, izolacji i usuwania artefaktów wizualnych w obrazach cyfrowych. To podejście wykorzystuje algorytmy AI zdolne do wysoce precyzyjnego przetwarzania obrazu, analizując informacje przestrzenne i kontekstowe, co umożliwia:

- dokładność wykrywania artefaktów na poziomie pikseli przekraczającą 95%,

- przetwarzanie w czasie rzeczywistym ze średnią prędkością 30 klatek na sekundę na dedykowanych procesorach GPU,

- adaptacyjne rozpoznawanie wzorców optymalizujące rozróżnianie obiektów w skomplikowanych scenach.

Architektury CNN wyodrębniają cechy hierarchiczne, ułatwiając bezproblemowe usuwanie artefaktów bez naruszania integralności obrazu: spójność strukturalna i metryki zgodności kolorów poprawiły się o około 12%. Odporność systemu wynika z ciągłego trenowania modelu na różnorodnych zbiorach danych, co zapewnia skalowalność przy różnych rozdzielczościach obrazów — od 72 do 600 dpi — redefiniując tym samym standardy wydajności w zautomatyzowanych przepływach pracy korekcji zdjęć, które mogą być integrowane z systemami takimi jak inteligentne oświetlenie Homekit.

Kluczowe cechy narzędzi do usuwania obiektów AI

Liczne istotne cechy definiują skuteczność narzędzi do usuwania obiektów za pomocą AI, które wykorzystują najnowocześniejsze metody optymalizujące usuwanie artefaktów przy jednoczesnym zachowaniu wewnętrznej jakości obrazu: te możliwości umożliwiają drobiazgową manipulację i solidną wydajność na zróżnicowanych zbiorach danych. Kluczowe elementy obejmują:

- Zaawansowane algorytmy rekonstrukcji obrazu wykorzystujące splotowe sieci neuronowe (CNN) do inpainting’u świadomego kontekstu, zapewniające płynną interpolację pikseli.

- Wielowarstwowe ramy segmentacji, które precyzyjnie izolują obiekty pierwszego planu, minimalizując utratę danych ubocznych podczas usuwania.

- Silniki przetwarzania w czasie rzeczywistym wykorzystujące akcelerację GPU, optymalizujące przepustowość i opóźnienia w złożonych manipulacjach obrazem.

- Rozbudowane metryki porównawcze oprogramowania dotyczące wiernego odtwarzania, szybkości przetwarzania i minimalizacji artefaktów, które kierują wyborem na podstawie empirycznych benchmarków.

- Adaptacyjne moduły syntezy tekstur integrujące modele stochastyczne i deterministyczne, umożliwiające naturalną rekonstrukcję złożonych teł.

Te cechy łącznie zwiększają dokładność operacyjną, ułatwiając konsekwentne, wysokiej jakości wyniki niezbędne w profesjonalnym dopracowywaniu i analizie obrazów.

Krok po kroku: usuwanie obiektów ze zdjęć

Procedura usuwania niechcianych elementów z fotografii składa się z ciągu starannie dobranych operacji mających na celu optymalizację precyzji i zachowanie spójności, a w przypadku użytkowników iPhone’ów, zaawansowane możliwości oferuje Visual Look Up w zdjęciach na iPhonie, pozwalając na identyfikację obiektów i tekstu bezpośrednio na fotografii.

| Krok | Technika | Korzyść |

|---|---|---|

| 1. Wykrywanie obiektów | Głębokie sieci neuronowe | Wysoka dokładność, automatyczna segmentacja |

| 2. Generowanie maski | Maskowanie poligonowe/wektorowe | Precyzyjne wyznaczanie granic |

| 3. Doprecyzowanie | Algorytmy wygładzania krawędzi | Redukcja artefaktów |

| 4. Inpainting | Kontekstowa synteza tekstur | Bezszwowa rekonstrukcja wizualna |

Najlepsze oprogramowanie do edycji zdjęć z wykorzystaniem sztucznej inteligencji

Postępy w sieciach neuronowych konwolucyjnych oraz generatywnych sieciach przeciwnikowych zrewolucjonizowały możliwości przetwarzania obrazów, jednak wybór opartego na sztucznej inteligencji oprogramowania do edycji zdjęć wymaga rygorystycznej oceny pod kątem wydajności algorytmów, integracji funkcji oraz wierności wyjścia; wiodące rozwiązania wykazują kluczowe kompetencje w wielu parametrach, w tym:

- Precyzja inpaintingu: algorytmy rekonstruujące zasłonięte obszary z dokładnością subpikselową, poprawiające jakość usuwania obiektów

- Szybkość przetwarzania w czasie rzeczywistym: silniki akcelerowane przez GPU pozwalające na opóźnienie poniżej 200 milisekund na obraz 4K

- Adaptacyjna synteza tekstur: kontekstowe łączenie cech zapobiegające artefaktom wizualnym po edycji

- Obsługa wielu warstw: jednoczesna edycja warstw kompozytowych umożliwiająca nieniszczące przepływy pracy

- Kompatybilność międzyplatformowa: płynna integracja w środowiskach desktopowych i mobilnych z zachowaniem spójnego zarządzania kolorami

To porównanie oprogramowania podkreśla możliwości niezbędne dla profesjonalnej edycji zdjęć i odporności algorytmicznej, spełniając surowe normy techniczne.

Wskazówki dotyczące osiągania naturalnie wyglądających poprawek

Osiągnięcie naturalnie wyglądających edycji wymaga dogłębnego zrozumienia nauki o kolorze, zachowania częstotliwości przestrzennej oraz utrzymania ciągłości krawędzi — każdy z tych czynników ma kluczowe znaczenie dla spójności percepcyjnej i minimalizacji zniekształceń wywołanych przez algorytmy, co jest szczególnie widoczne podczas nagrywania wideo w formacie Apple Log. Idealne naturalne edycje wymagają:

- przestrzegania kalibracji kolorów z progiem ΔE<2, aby zagwarantować wierność chromatyczną;

- algorytmów rekonstrukcji wysokoczęstotliwościowej tekstury zachowujących komponenty częstotliwości przestrzennej powyżej 10 cykli/mm, aby utrzymać realizm powierzchni;

- algorytmów ciągłości krawędzi wykorzystujących techniki domeny gradientu dla nieprzerwanych przesunięć na zmodyfikowanych granicach.

Bezproblemowe łączenie osiąga się dzięki wieloskalowym podejściom do retuszu, które obejmują zarówno globalne korekty luminancji, jak i lokalną syntezę mikrostruktur, zapobiegając w ten sposób powstawaniu obwódek i widocznych szwów. Dodatkowo, wykorzystanie świadomych kontekstu modeli uzupełniania obrazu skalibrowanych na zbiorach danych o wysokiej rozdzielczości umożliwia usuwanie obiektów bez artefaktów, zwiększając autentyczność uzyskanych rezultatów. Te specyfikacje techniczne łącznie prowadzą do precyzyjnych, nieodczuwalnych zmian zgodnych z czułością ludzkiego systemu wzrokowego, promując wiarygodne i naturalistyczne efekty rekonstrukcji obrazu.

Typowe wyzwania i sposoby ich pokonania

Z uwagi na złożoność inherentną w zautomatyzowanych algorytmach korekcji obrazów, pojawiają się różnorodne wyzwania podczas procesu czyszczenia zdjęć—z których każde wymaga ukierunkowanych metodologicznych działań zaradczych. Główne przeszkody obejmują ograniczenia algorytmiczne wpływające na bezszwowe usuwanie obiektów, zagrożenia niezamierzonych zniekształceń oraz balansowanie pomiędzy doświadczeniem użytkownika a złożonością obliczeniową. Ponadto, kwestie etyczne nakładają obowiązek transparentności w modyfikacjach AI, zapewniając zachowanie autentyczności. Strategie techniczne obejmują:

- Zwiększenie precyzji wykrywania krawędzi poprzez wieloskalarne konwolucyjne sieci neuronowe w celu minimalizacji powstawania artefaktów

- Wdrożenie adaptacyjnych algorytmów inpaintingu dla utrzymania spójności kontekstowej

- Optymalizację interfejsów użytkownika dla intuicyjnej obsługi, redukując obciążenie poznawcze

- Integrację modułów wyjaśnialnej sztucznej inteligencji w celu zapewnienia etycznej transparentności

- Stosowanie iteracyjnych pętli informacji zwrotnej, dynamicznie dopracowujących progi korekcji

Te precyzyjne interwencje zbiorczo podnoszą skuteczność czyszczenia, utrzymują standardy etyczne oraz sprzyjają lepszemu doświadczeniu użytkownika poprzez systematyczną minimalizację błędów i jasność działania, co jest szczególnie ważne przy tworzeniu profesjonalnych Reels na iPhonie.

Ulepszanie zdjęć wykraczające poza usuwanie obiektów

Postępując od technik usuwania obiektów, usprawnianie zdjęć rozszerza możliwości operacyjne, aby kompleksowo udoskonalić cechy obrazu. Proces ten obejmuje zestaw funkcji — od regulacji zakresu dynamicznego po poprawę wierności chromatycznej — umożliwiając precyzyjną manipulację kontrastem, nasyceniem oraz rozdzielczością tekstury. Takie kreatywne edycje optymalizują spójność wizualną przy jednoczesnym zachowaniu autentycznych detali, tym samym zwiększając jakość percepcyjną przy standardach druku 300 dpi lub normach wyświetlania cyfrowego 72 ppi. Poniższa tabela przedstawia kluczowe parametry ulepszeń oraz odpowiadające im efekty:

| Parametr ulepszenia | Specyfikacja techniczna i korzyść |

|---|---|

| Regulacja kontrastu | modulacja w skali 0–100: poprawia rozróżnienie tonów |

| Kolor grading | głębia kolorów 32-bit: umożliwia zniuansowaną kalibrację odcieni |

| Wyostrzenie tekstury | rozmiar jądra 3×3 piksele: zwiększa definicję krawędzi |

| Redukcja szumów | filtrowanie częstotliwości przestrzennych: zmniejsza artefakty ziarnistości |

| Korekcja ekspozycji | zakres EV ±3 stopni: przywraca detale w światłach i cieniach |

Ta ustrukturyzowana metodologia umożliwia innowacyjne, ilościowo precyzyjne usprawnianie zdjęć wykraczające poza samo usuwanie obiektów.

Najczęściej zadawane pytania

Czy usuwanie obiektów za pomocą sztucznej inteligencji wpływa na rozdzielczość zdjęcia?

Usuwanie obiektów za pomocą AI powoduje marginalny wpływ na rozdzielczość — zazwyczaj zmniejszenie o 0,5 do 2 megapikseli — ze względu na lokalną interpolację pikseli i algorytmy inpaintingu. Jakość obrazu jest proporcjonalna do zaawansowania modelu: zaawansowane sieci neuronowe zachowują ostrość krawędzi, wierność kolorów oraz ciągłość tekstur poprzez zastosowanie analizy wieloskalowej i syntezy opartej na patchach. Natomiast proste metody mogą wprowadzać artefakty, co prowadzi do pogorszenia percepcyjnej klarowności. W konsekwencji idealne narzędzia AI balansują złożoność obliczeniową z minimalną utratą rozdzielczości, umożliwiając efektywne usunąć obiekty za pomocą AI, zapewniając zachowanie detali w wysokorozdzielczych obrazach.

Czy narzędzia do oczyszczania AI mogą działać offline?

Narzędzia do czyszczenia AI często oferują funkcjonalność offline, zależną od architektury oprogramowania i możliwości sprzętowych: aplikacje instalowane lokalnie zapewniają pełną kompatybilność offline, umożliwiając nieprzerwaną pracę bez konieczności korzystania z internetu; przeciwnie, platformy uzależnione od chmury wymagają stałego połączenia, wykluczając możliwość użycia offline. Kompatybilność oprogramowania obejmuje systemy operacyjne — Windows (≥10), macOS (≥11) — oraz zasoby obliczeniowe, wymagając minimalnej akceleracji GPU (4 GB VRAM) i 8 GB RAM, aby zoptymalizować wydajność algorytmów i zachować integralność obrazu podczas usuwania obiektów.

Czy narzędzia do usuwania AI są bezpieczne dla profesjonalnej fotografii?

Narzędzia do usuwania AI, stosowane w profesjonalnej fotografii, stwarzają obawy dotyczące bezpieczeństwa AI, w tym luki w ochronie danych — wymagające standardów szyfrowania AES-256 — oraz potencjalne uprzedzenia algorytmiczne wpływające na integralność obrazu, co wymaga przestrzegania kodeksów etyki zawodowej. Narzędzia te oferują korzyści takie jak wysokiej jakości rekonstrukcja pikseli, nieniszczące przepływy pracy edycyjne oraz zachowanie metadanych, umożliwiając precyzyjne usuwanie obiektów z dokładnością subpikselową (~0,1 px). W rezultacie ich zastosowanie wymaga rygorystycznych protokołów walidacji oraz ram etycznego użytkowania, aby zapewnić niezawodne i zgodne z przepisami wyniki obrazowania.

Jak AI radzi sobie ze skomplikowanymi tłami?

AI zarządza skomplikowanymi tłami za pomocą zaawansowanych algorytmów analizy tła oraz rygorystycznych protokołów rozpoznawania obiektów — systemy te wykorzystują konwolucyjne sieci neuronowe (CNN) z dokładnością przekraczającą 92%, co umożliwia precyzyjne rozróżnianie obiektów pierwszego planu od wielowarstwowych środowisk, podobnie jak w przypadku technologii wyświetlania, gdzie różnice między ekranami OLED a innymi typami mogą wpływać na percepcję głębi i kolorów. Kluczowe komponenty techniczne to: wielowarstwowa segmentacja do estymacji głębi, klastrowanie w przestrzeni barw dla wyznaczania krawędzi oraz mapowanie semantyczne w celu kontekstualizacji sąsiednich pikseli. Ta integracja gwarantuje solidne wyodrębnianie obiektów i optymalizuje jakość post-processingu, redukując generowanie artefaktów oraz zachowując spójność strukturalną.

Czy istnieje ryzyko naruszenia praw autorskich przy używaniu edycji AI?

Znaczące implikacje praw autorskich pojawiają się przy wdrażaniu edycji obrazów z wykorzystaniem AI, szczególnie w kontekście pochodzenia materiałów źródłowych, klasyfikacji prac pochodnych oraz ryzyka nieautoryzowanego powielania. Etyczne kwestie dotyczą również autentyczności treści, przypisania twórcy oraz mechanizmów zgody w ramach zbiorów danych treningowych AI. Przestrzeganie przepisów dotyczących własności intelektualnej gwarantuje zgodność oraz ogranicza potencjał do sporów sądowych. Korzyści innowacyjne obejmują przyspieszenie efektywności pracy, precyzyjne usuwanie obiektów (dokładność ±0,5 piksela) oraz skalowalną obróbkę wsadową, uzależnione od solidnych ram prawnych integrujących zautomatyzowane protokoły zarządzania prawami.